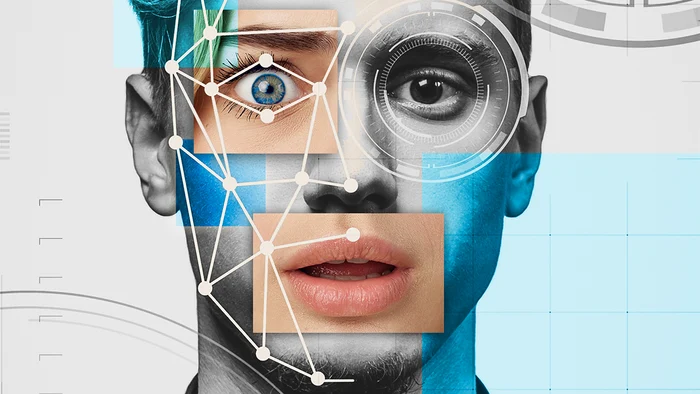

Mii de vedete, victime ale pornografiei deepfake. „Este pur și simplu foarte violent, foarte degradant”

0Aproape 4.000 de persoane celebre au fost victime ale pornografiei deepfake, arată o analiză a Channel 4 News. Dintre acestea, peste 250 au fost vedete din Marea Britanie.

O analiză a Channel 4 News a celor mai vizitate cinci site-uri web deepfake a constatat că aproape 4.000 de persoane celebre au fost victime, dintre care 255 sunt de origine britanică, relatează The Guardian.

Actori, cântăreți, YouTuberi, vedete de televiziune se numără printre persoanele care apar în deepfake porn, realizate cu ajutorul inteligenței artificiale (IA).

În numai trei luni, cele cinci site-uri analizate au strâns 100 de milioane de vizualizări.

O prezentatoare de la Channel 4 News, care se numără printre victime, Cathy Newman, a declarat: „Se simte ca o încălcare. Mi se pare cu adevărat sinistru că cineva de acolo, care a pus toate astea cap la cap, pe care eu nu-l pot vedea, poate vedea acest fel de versiune imaginară a mea, această versiune falsă a mea.", conform sursei citate.

În Regatul Unit, Legea privind siguranța online produce efecte din 31 ianuarie. Aceasta interzice distribuirea acestor imagini fără consimțământ, dar crearea conținutului nu este ilegală. Legislația a fost adoptată ca răspuns la proliferarea pornografiei deepfake create de AI și aplicații.

În Europa, Legea I.A. este cea care ne protejează de filmulețele deepfake și de fakenews, directiva a fost adoptată recent.

De la un singur videoclip deepfake, la sute de mii

În 2016, cercetătorii au identificat un singur videoclip pornografic deepfake online. Numai în primele nouă luni ale lui 2023 au fost încărcate 143.733 de noi videoclipuri pornografice deepfake pe cele mai utilizate 40 de site-uri de pornografie deepfake - mai mult decât în toți anii anteriori la un loc, potrivit jurnaliștilor britanici.

„Este pur și simplu foarte violent, foarte degradant. Este ca și cum femeile nu înseamnă nimic, suntem inutile, suntem doar o bucată de carne. Bărbații pot face ce vor. Am avut încredere în toată lumea înainte de asta.", a declarat Sophie Parrish, în vârstă de 31 de ani, care a descoperit că imagini nud fabricate cu ea au fost postate online.

Organismul de supraveghere a audiovizualului din Marea Britanie, Ofcom, va pune în aplicare legea privind siguranța online.

„Materialele deepfake ilegale sunt profund deranjante și dăunătoare. În conformitate cu Legea privind siguranța online, firmele vor trebui să evalueze riscul ca acest tip de conținut să circule pe serviciile lor, să ia măsuri pentru a împiedica apariția acestuia și să acționeze rapid pentru a-l elimina atunci când iau cunoștință de el. Deși normele nu sunt încă în vigoare, încurajăm companiile să implementeze aceste măsuri și să își protejeze utilizatorii acum.", spun reprezentanții Ofcom.

Ce spun giganții tehnologici

„Înțelegem cât de angoasant poate fi acest conținut și ne angajăm să ne bazăm pe protecțiile noastre existente pentru a ajuta persoanele afectate. Conform politicilor noastre, oamenii pot obține ca paginile care prezintă acest conținut și care includ imaginea lor să fie eliminate din căutare. Și, în timp ce aceasta este o provocare tehnică pentru motoarele de căutare, dezvoltăm în mod activ măsuri de protecție suplimentare în cadrul căutării Google - inclusiv instrumente pentru a ajuta oamenii să se protejeze la scară largă, împreună cu îmbunătățiri ale clasamentului pentru a aborda acest conținut la scară largă.", au transmis reprezentanții Google.

Copiii folosesc Tik-Tok înainte să învețe alfabetul, iar asta le va aduce probleme reale la școală, atrag atenția psihologiiLa rândul lor, cei de la Meta au declarat că interzic acest gen de conținut.

„Meta interzice cu strictețe nuditatea infantilă, conținutul care sexualizează copiii și serviciile care oferă imagini nud non-consensuale generate de inteligența artificială. În timp ce această aplicație [care creează deepfakes] rămâne disponibilă pe scară largă în diverse magazine de aplicații, am eliminat aceste reclame și conturile din spatele lor.", a afirmat Ryan Daniels de la Meta, care deține Facebook și Instagram.

Deepfake în România

Un studiu realizat de World Vision România arată că unui copil din zece i-a fost falsificată imaginea și vocea, iar conținutul a fost distribuit pe internet. Aproape un sfert din adolescenți spun că altor colegi sau prieteni li s-a falsificat vocea, imaginea și conținutul fals a fost distribuit ori că adolescenții de aceeași vârstă au fost amenințați cu pornografia din răzbunare, potrivit sondajului World Vision România.

„Nu mă sperie inteligența artificială în sine, cât oribilitățile pe care oamenii le pot face cu ea. Cum ar fi să distribui imagini false cu femei și copii nud care par reale. Pentru că este un fenomen deja. Se numește «deepfake porn» și nu I se întâmplă doar lui Taylor Swift sau altor celebrități. Unul din zece copii care a răspuns recent la un sondaj făcut de World Vision România spune că a fost distribuit pe internet conținut cu vocea sau imaginea lor modificate. Se întâmplă și public, și în grupuri mai restrânse”, a reacționat Florinela Iosip, reprezentant al World Vision România, pe pagina personală de pe Facebook.

Iar copiii pot fi afectați în multe moduri de filmulețele realizate cu ajutorul IA, la fel și adulții, spun psihologii.

Legea IA adoptată de Parlamentul european își propune să ne protejeze de deepfake și fake news, pentru că, altfel, internetul se poate transforma într-un monstru, avertizează experții în securitate cibernetică.

Directiva europeană în domeniul I.A. stabilește că, în cazul inteligențelor artificiale generative, care pot produce texte, sunete sau imagini la cerere, regulile vor fi impuse pentru asigurarea calităţii datelor utilizate în stabilirea algoritmilor şi pentru a verifica respectarea legislației europene privind drepturile de autor. De asemenea, dezvoltatorii vor trebui să precizeze că sunetele, imaginile şi textele produse de I.A. sunt artificiale.