ChatGPT evoluează „spre dreapta” în ceea ce privește partizanatul politic - studiu

0Potrivit unui nou studiu, ChatGPT înregistrează o evoluție spre dreapta în spectrul politic în ceea ce privește modul în care răspunde la interogările utilizatorilor, relatează euronews.com.

Cercetătorii chinezi au descoperit că ChatGPT, popularul chatbot de inteligență artificială (AI) al OpenAI, înregistrează o deplasare spre dreapta a valorilor politice.

Studiul, publicat în revista Humanities and Social Science Communications, a adresat mai multor modele de ChatGPT 62 de întrebări din Political Compass Test, un site web online care plasează utilizatorii undeva în spectrul politic pe baza răspunsurilor lor.

Aceștia au repetat apoi întrebările de peste 3 000 de ori cu fiecare model pentru a-și da seama cum s-au schimbat răspunsurile în timp.

În timp ce ChatGPT menține în continuare valorile „stângii libertariene”, cercetătorii au constatat că modele precum GPT3.5 și GPT4 „prezintă o înclinare semnificativă spre dreapta”, în ceea ce privește modul în care au răspuns la întrebări de-a lungul timpului.

Rezultatele sunt „demne de remarcat având în vedere utilizarea pe scară largă a modelelor lingvistice mari (LLM) și influența lor potențială asupra valorilor societale”, au declarat autorii studiului.

Studiul Universității Peking se bazează pe altele publicate în 2024 de Institutul de Tehnologie din Massachusetts (MIT) și de Centrul pentru Studii Politice din Regatul Unit.

Ambele rapoarte au indicat o prejudecată politică de stânga în răspunsurile date de LLM-uri și de așa-numitele modele de recompensă, tipuri de LLM-uri antrenate pe baza datelor privind preferințele umane.

Autorii notează că aceste studii anterioare nu au analizat modul în care răspunsurile roboților de chat AI s-au schimbat în timp atunci când li s-a adresat un set similar de întrebări în mod repetat.

Modelele de inteligență artificială ar trebui să fie supuse unei „examinări continue”

Cercetătorii oferă trei teorii pentru această schimbare spre dreapta: o schimbare în seturile de date utilizate pentru antrenarea modelelor lor, numărul de interacțiuni cu utilizatorii sau modificări și actualizări ale chatbotului.

Modele precum ChatGPT „învață și se adaptează în mod continuu pe baza feedback-ului utilizatorilor”, astfel încât schimbarea lor spre dreapta ar putea „reflecta schimbări societale mai ample în ceea ce privește valorile politice”, continuă studiul.

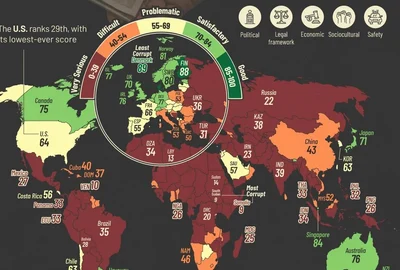

Evenimentele mondiale polarizante, precum războiul Rusia-Ucraina, ar putea, de asemenea, să amplifice întrebările pe care utilizatorii le adresează LLM-urilor și răspunsurile pe care le primesc.

Dacă nu sunt controlate, cercetătorii au avertizat că chatbot-urile AI ar putea începe să furnizeze „informații distorsionate”, care ar putea polariza și mai mult societatea sau ar putea crea „camere de ecou” care să consolideze convingerile specifice ale unui utilizator.

Potrivit autorilor studiului, modalitatea de contracarare a acestor efecte este de a introduce o „examinare continuă” a modelelor AI prin audituri și rapoarte de transparență, pentru a se asigura că răspunsurile unui chatbot sunt corecte și echilibrate.