Imaginile deepfake virale ale războiului din Gaza: bebeluși însângerați, abandonați printre ruine

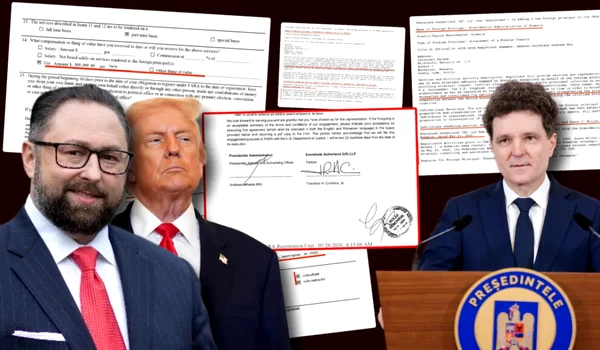

0Imagini extrem de realiste cu bebeluși însângerați, prezentate drept scene ale războiului dintre Israel și Hamas, ilustrează potențialul tot mai îngrijorător al inteligenței artificiale în calitate de instrument de propagandă și armă. De la începutul războiului, luna trecută, imagini modificate digital și răspândite pe rețelele de sociale au fost folosite pentru a face afirmații false cu privire la responsabilitatea pentru victime sau pentru a înșela cu privire la atrocități care nu au avut loc în realitate, relatează AP.

„Imagini, video și audio: cu ajutorul inteligenței artificiale generative, va fi o escaladare pe care nu ați mai văzut-o”, a aubliniat Jean-Claude Goldenstein, CEO al CREOpoint, o companie de tehnologie cu sediul în San Francisco și Paris care folosește inteligența artificială pentru a evalua validitatea afirmațiilor online. Compania a creat o bază de date cu cele mai virale conținuturi manipulate și prezentate ca fiind din Gaza.

Acestea constau din fotografii din alte conflicte sau dezastre sau scene generate de IA, cum ar fi cea a unui bebeluș plângând printre ruinele bombardamentelor, care a devenit virală în primele zile ale conflictului.

Alte conținuturi sunt videoclipuri cu presupuse atacuri israeliene cu rachete, tancuri traversând cartiere distruse sau familii căutând supraviețuitori printre dărâmături.

Principalul scop al acestor imagini manipulate în care apar cadavre ale unor bebeluși, copii sau familii este să evoce o reacție emoțională puternică. În primele zile sângeroase ale războiului, atât susținătorii Israelului, cât și cei ai mișcării islamiste Hamas au acuzat cealaltă parte că a inventat victime vulnerabile precum copii și bebeluși. În acest context, imagini deepfake cu bebeluși plângând au fost oferite drept „dovezi” fotografice.

Propagandiștii care creează astfel de imagini au expertiza de a face apel la cele mai profunde impulsuri și anxietăți ale oamenilor, a declarat Imran Ahmed, director executiv al Centrului pentru combaterea urii digitale, o organizație non-profit care a monitorizat dezinformarea din timpul războiului. Fie că este vorba de un bebeluș deepfake, fie de o imagine reală a unui copil dintr-un alt conflict, impactul emoțional asupra privitorului este același.

Cu cât imaginea este mai detestabilă, cu atât este mai probabil ca un utilizator să și-o amintească și să o partajeze, răspândind fără să vrea și mai mult dezinformarea.

"Oamenilor li se spune chiar acum: Uitați-vă la această imagine a unui copil. Dezinformarea este concepută pentru a vă face să interacționați cu ea”, a explicat el.

În întreaga lume, o serie de firme de tehnologie lucrează la noi programe care pot depista imaginile manipulate digital, pot aplica filigrane pe imagini pentru a le dovedi proveniența sau pot scana texte pentru a verifica afirmații înșelătoare care ar fi putut fi introduse de inteligența artificială.

„Următorul val de inteligență artificială va fi: Cum putem să verificăm conținutul de pe internet. Cum poți detecta dezinformarea, cum poți analiza textul pentru a stabili dacă este demn de încredere?", a explicat Maria Amelie, cofondator al Factiverse, o companie norvegiană care a creat un program de IA care poate scana conținutul pentru a detecta inexactitățile sau prejudecățile introduse de alte programe de IA.