„Naşul AI" şi alţi experţi cer „întreruperea lanţului de aprovizionare pentru deepfake”, învocând riscuri potenţiale

0Experţi din domeniul inteligenţei artificiale (AI) şi directori ai unor companii din industria de profil, inclusiv unul dintre pionierii acestei tehnologii, Yoshua Bengio, au semnat o scrisoare deschisă prin care au cerut o reglementare mai strictă a conţinuturilor de tip „deepfake”, invocând riscuri potenţiale pentru societatea umană, informează Reuters, citată de Agerpres.

„În prezent, conţinuturile 'deepfake' implică adeseori imagini cu caracter sexual, fraude şi dezinformare politică. Deoarece AI progresează rapid şi face ca producţiile 'deepfake' să fie mult mai uşor de creat, sunt necesare măsuri de protecţie", a afirmat grupul în scrisoarea deschisă redactată de Andrew Critch, cercetător în domeniul inteligenţei artificiale la Universitatea California din Berkeley.

Ce sunt conţinuturile „deepfake”

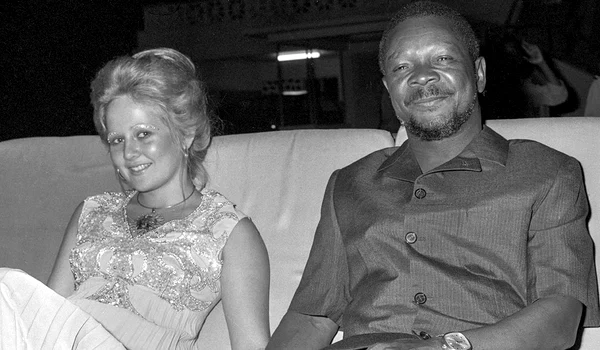

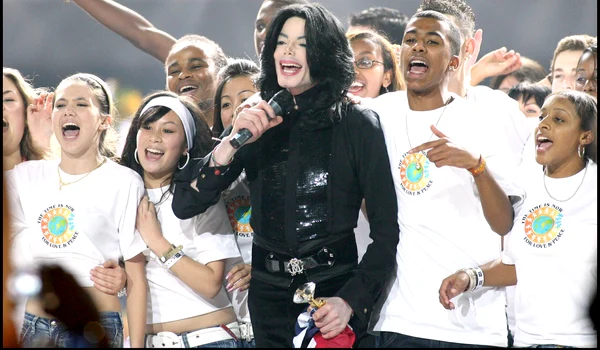

Conţinuturile „deepfake” sunt imagini, înregistrări audio şi video realiste, dar trucate, create de algoritmi de inteligenţă artificială, iar progresele recente ale acestei tehnologii au făcut ca ele să devină din ce în ce mai greu de diferenţiat de conţinuturile create de oameni.

Recomandări cu privire la modul de reglementare a conţinuturilor „deepfake"

În scrisoarea deschisă, intitulată „Disrupting the Deepfake Supply Chain" ("Întreruperea lanţului de aprovizionare pentru deepfake"), este făcută o serie de recomandări cu privire la modul de reglementare a conţinuturilor „deepfake", inclusiv incriminarea completă a pornografiei infantile de tip „deepfake" şi sancţiuni penale pentru orice persoană care creează sau facilitează cu bună ştiinţă răspândirea de „deepfake" dăunătoare, solicitând totodată companiilor de inteligenţă artificială să împiedice produsele lor să creeze conţinuturi „deepfake" dăunătoare.

Peste 400 de persoane din diverse industrii, inclusiv din mediul academic, divertisment şi politică, semnaseră scrisoarea până miercuri dimineaţă.

Steven Pinker, profesor de psihologie la Universitatea Harvard, Joy Buolamwini, fondatoarea Ligii Justiţiei Algoritmice, doi foşti preşedinţi estonieni, cercetători de la Google DeepMind şi un cercetător de la OpenAI sunt printre semnatari.

Prioritățile autorităţilor de reglementare

Garantarea faptului că sistemele de inteligenţă artificială nu dăunează societăţii a fost o prioritate pentru autorităţile de reglementare după ce compania OpenAI, susţinută de Microsoft, a lansat ChatGPT la sfârşitul anului 2022, care a uimit utilizatorii prin capacitatea sa de a susţine conversaţii asemănătoare cu cele umane şi prin uşurinţa cu care îndeplineşte diverse alte sarcini.

Avertismente

Mai multe avertismente au venit din partea unor personalităţi proeminente cu privire la riscurile generate de AI, în special o scrisoare semnată de Elon Musk anul trecut, în care se cerea o pauză de şase luni în dezvoltarea unor sisteme mai puternice decât modelul de inteligenţă artificială GPT-4 creat de OpenAI.