INTERVIU Radu Uszkai, cercetător în etică aplicată: „Consumăm conținut pe bandă rulantă, dar nu avem reflexul de a-l verifica”

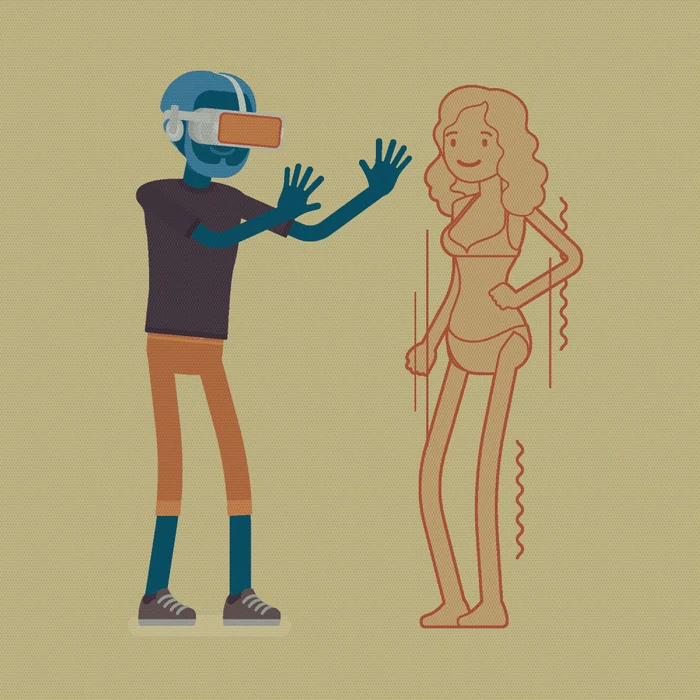

0Într-o epocă în care imaginile foto/video pot fi modificate sau fabricate cu o ușurință incredibilă, ce părea de neimaginat în urmă cu câteva decenii, deepfake-ul a devenit una dintre cele mai perfide amenințări la adresa adevărului și a vieții private. De la utilizarea ca instrument de cyberbullying (hărțuire digitală) și propagandă politică până la escrocherii financiare sau manipularea opiniei publice, impactul acestor tehnologii este greu de ignorat.

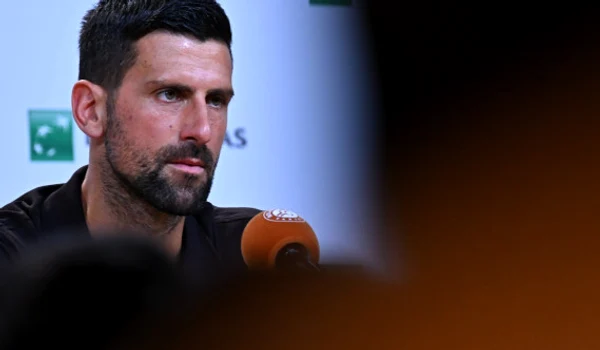

„Weekend Adevărul“ a discutat cu Radu Uszkai, cercetător în cadrul proiectului „avataResponsibility: Influența avatarurilor bazate pe inteligență artificială asupra comportamentului moral individual și colectiv“ al Centrului de Cercetare în Etică Aplicată, despre riscurile asociate deepfake-ului, modul în care acesta exploatează vulnerabilitățile cognitive ale oamenilor și ce măsuri putem lua pentru a ne proteja.

„Weekend Adevărul“: În ce măsură mai avem control asupra vieții noastre private în era digitală, având în vedere că imaginile pe care le postăm pot fi folosite fără consimțământul nostru?

Radu Uszkai: Într-o oarecare măsură, am renunțat la viața noastră privată din momentul în care am început să postăm conținut online. Acesta este un aspect despre care trebuie să fim foarte conștienți: în clipa în care încărcăm imagini, videoclipuri sau înregistrări audio pe rețele sociale, ele nu mai aparțin unui spațiu privat, ci devin parte dintr-un spațiu public.

Dar chiar avem opțiunea reală de a nu participa la acest ecosistem digital? Într-o lume atât de conectată, nu suntem forțați, într-un fel, să facem parte din el?

Într-adevăr. Mecanismele sociale și economice ne obligă, într-o oarecare măsură, să participăm la acest joc digital. Fie că este vorba despre rețele sociale, platforme de networking profesional, aplicații de mesagerie sau chiar servicii esențiale pentru care avem nevoie de o prezență online, este aproape imposibil să trăiești complet deconectat. Însă asta nu înseamnă că trebuie să acceptăm că expunerea noastră este inevitabilă sau că nu putem adopta măsuri pentru a ne proteja. Nu vom putea niciodată să eliminăm complet riscul ca imaginile noastre să fie manipulate în scopuri negative. Perfecțiunea este, de multe ori, inamicul îmbunătățirilor marginale. Nu cred că vom trăi vreodată într-o societate în care să putem elimina complet toate riscurile la care suntem expuși. De exemplu, înainte de inventarea automobilelor, nu existau oameni care să moară loviți de mașini. Sigur, existau accidente cu birje, dar nu la aceeași scară. Astăzi, în continuare există accidentele rutiere – în unele locuri mai multe, cum e cazul României, în altele mai puține, cum vedem în statele din Vest. Diferența nu vine doar din infrastructura mai bună, ci și dintr-o cultură mai dezvoltată a responsabilității în trafic. Făcând o analogie cu deepfake-urile, cred că nu vom putea niciodată să eliminăm complet riscul ca imaginile noastre să fie manipulate în scopuri negative, dar putem încerca să le reducem. Pe de o parte, avem nevoie de soluții tehnologice mai avansate care să prevină utilizarea abuzivă a deepfake-urilor. Pe de altă parte, ar trebui să adoptăm o cultură digitală mai precaută, unde să fim mai conștienți de expunerea noastră în mediul online. E ca atunci când traversăm strada – te uiți în stânga și în dreapta înainte de a face un pas. La fel ar trebui să procedăm și cu informațiile pe care le postăm pe internet. Cu siguranță trebuie să ne uităm și la ce anume îi determină pe oameni să facă astfel de lucruri. Fără să analizăm factorii psihologici, economici, morali sau politici din spatele acestor acțiuni, nu cred că vom putea rezolva eficient problemele generate de aceste inovații – care, de altfel, au și un potențial fabulos. Aceste tehnologii nu sunt, prin definiție, rele. Dimpotrivă, ele pot avea aplicații extraordinare, dar, dacă nu înțelegem ce îi determină pe oameni să le folosească abuziv, nu vom putea construi o lume mai bună și mai sigură.

Slăbiciunile cognitive ale oamenilor

În acest caz, cum putem să mai avem încredere în ceea ce vedem și auzim în online? Unde mai este adevărul în această ecuație?

Nu mai putem avea încredere oarbă și, de fapt, ar trebui să devenim din ce în ce mai sceptici. În afară de sursele cu care am dezvoltat o relație personală sau care au o reputație consolidată, cel mai sănătos ar fi să plecăm de la premisa că orice conținut care ne contrazice așteptările rezonabile trebuie verificat înainte de a fi considerat real. Reacția noastră inițială ar trebui să fie una de scepticism imediat. Revin asupra cazului de deepfake cu Mugur Isărescu, în care circulau reclame false în care guvernatorul BNR îi îndemna pe oameni să investească în criptomonede dubioase. În cazul de față, cred că putem să aplicăm niște reguli minimale de logică și gândire critică.

Problema nu este doar cât de sofisticate sunt falsurile, ci cât de vulnerabili suntem noi la astfel de manipulări.

Totuși, aceste scamuri ajung exact la persoanele cele mai vulnerabile...

Absolut, aici este principala problemă. Ne lipsește, dacă vreţi, o infrastructură filosofică și educațională care să ne ajute să discernem între adevăr și fals. Avem nevoie de reguli deductive și inductive pe care să le aplicăm atunci când verificăm autenticitatea unei informații. Acest deficit nu este doar în România, ci peste tot în lume – educația formală și informală au eșuat, în multe cazuri, să ofere oamenilor instrumente solide de gândire critică. Dar asta nu înseamnă că doar cei fără educație sunt vulnerabili. Chiar și persoanele cu un grad ridicat de sofisticare intelectuală pot cădea pradă manipulării. Deepfake-urile sunt create tocmai pentru a specula slăbiciunile cognitive ale fiecăruia dintre noi, iar în era digitală, verificarea informației trebuie să devină un reflex esențial.

Decizii la secundă

Pare că, în acest mediu digital suprasaturat de informații, capacitatea noastră de a discerne adevărul de fals devine din ce în ce mai greu de menținut.

Trăim într-o epocă a supraabundenței informaționale. Suntem bombardați constant cu conținut – fie că suntem pe Facebook, Twitter, Instagram, TikTok sau orice altă platformă. Problema este că timpul pe care îl avem pentru a procesa aceste informații și pentru a lua decizii bazate pe ele este semnificativ mai mic decât în trecut. Dacă înainte, dimineața, îți luai un ziar, citeai o știre despre creșterea prețului la cacao în America de Sud și îți puteai aloca ceva timp să decizi dacă investești sau nu în acțiuni, astăzi, totul se desfășoară într-un ritm mult mai accelerat.

Cum a ajuns fenomenul Deepfake o armă pentru fraude financiare, propagandă și manipulareDeci, practic, rețelele sociale ne-au răpit acest timp necesar reflecției?

Unul dintre marile defecte ale social media este că, deși ne oferă acces la o cantitate imensă de informație, ne privează de timpul necesar pentru a o procesa și înțelege. Consumăm conținut pe bandă rulantă, dar nu avem mereu reflexul de a-l verifica. Iar asta ne face vulnerabili în fața manipulării. Inclusiv deepfake-urile cu Mugur Isărescu și cele cu Brad Pitt, în urma cărora o femeie a fost victima fraudei financiare, nu au fost foarte bine realizate, dar tot au păcălit oameni. Problema nu este doar cât de sofisticate sunt falsurile, ci cât de vulnerabili suntem noi la astfel de manipulări. Oamenii văd o imagine cu Mugur Isărescu promovând criptomonede și, în loc să se întrebe dacă guvernatorul BNR chiar ar face o astfel de declarație, unii aleg să creadă orbește. La fel și în cazul femeii care i-a trimis bani lui Brad Pitt – nici măcar nu era un deepfake convingător, dar imaginea lui a fost suficientă pentru a o convinge. Departe de a învinovăți victimele, este dezirabil ca oamenii să își asume o mai mare responsabilitate pentru propria autonomie cognitivă. Dacă ai 10 minute să scrollezi pe Instagram sau TikTok, ai și 10 minute să verifici dacă Mugur Isărescu chiar a recomandat acea criptomonedă sau dacă Brad Pitt este internat într-un spital. Fact-checkingul (verificarea informațiilor) nu este dificil, dar este nevoie de un efort conștient pentru a face asta. Desigur, nu putem avea așteptarea nerezonabilă ca fiecare individ să detecteze deepfake-uri extrem de sofisticate – aici trebuie să intervină reglementările și soluțiile tehnologice, dar pentru cazurile mai evidente, un minim de verificare poate face diferența între a cădea pradă unei escrocherii și a te proteja.

„Nu există o protecție perfectă împotriva unor unelte cu un potențial distructiv“

Care ar trebui să fie primul pas atunci când vrem să verificăm autenticitatea unei informații sau a unui conținut suspect?

În primul rând, trebuie să verifici sursa. De unde provine informația? Pe ce site sau pagină a fost publicată? Dacă îmi amintesc bine, acel deepfake cu Mugur Isărescu apăruse inițial pe o pagină care clona identitatea unei mari publicații din România. Într-un astfel de caz, nu este deloc dificil să verifici dacă aceeași informație apare și pe site-ul oficial sau dacă există vreo confirmare în presa de referință. Aceeași metodă se aplică și în cazul multitudinii de pagini obscure care își schimbă constant numele. De exemplu, unele grupuri de Facebook, care inițial erau dedicate nostalgiei pentru „vremurile de altădată“, încep brusc, în perioade electorale, să promoveze mesaje politice. Nu e greu să verifici ce nume au mai avut aceste pagini sau grupuri în trecut și să îți dai seama că nu sunt surse credibile. După ce am verificat sursa, trebuie să ne uităm la detalii vizuale sau auditive care pot indica manipularea imaginilor. Aceste elemente ne pot ajuta, cel puțin preliminar, să ne formăm o opinie despre autenticitatea conținutului.

Există totuși unelte care ne pot ajuta să verificăm autenticitatea imaginilor și videoclipurilor?

Da, există câteva instrumente care pot fi utile. De exemplu, contentcredentials.org este o platformă unde utilizatorii pot încărca imagini sau videoclipuri pentru a verifica metadatele conținutului. Această unealtă oferă informații despre cum a fost modificat conținutul, dacă a fost editat și ce schimbări au fost făcute de-a lungul timpului. Sigur, nu este o soluție perfectă, dar este un pas înainte. Ce sper, sau ce pare plauzibil să se întâmple, este să avem unelte cât mai bune, să construim „ziduri“ de protecție cât mai solide care să ne apere, pe cât posibil, de deepfake-uri. Însă, să nu uităm că, în istorie, chiar și cetățile cu cele mai groase ziduri au căzut, precum Constantinopolul, și asta ne arată că nu există o protecție perfectă împotriva unor unelte cu un potențial distructiv. Mai ales atunci când narațiunea devine despre bine versus rău, despre noi contra lor, adevărul și autenticitatea devin secundare.

Mihai Rotariu (DNSC): „Tehnologia deepfake este și un instrument de manipulare a informației, de răspândire a știrilor false“„Nu avem încă o soluție clară“

Cât de complicată devine verificarea informației într-un peisaj digital unde adevărul pare tot mai greu de stabilit?

Este din ce în ce mai dificil, mai ales pentru că interesul multor oameni nu este, de fapt, în jurul adevărului, într-un sens strict filosofic. Nu este un fenomen exclusiv românesc, îl vedem peste tot. În Statele Unite, în special în ultimele trei campanii electorale, în Germania și în alte democrații avansate, vedem constant tactici de manipulare bazate pe scoaterea declarațiilor din context sau pe discreditarea surselor. Când vine vorba de deepfake-uri și dezinformare, trebuie să recunoaștem că nu avem încă o soluție clară. Cred că avem o datorie publică de a spune deschis: „Nu știm încă cum să rezolvăm complet această problemă“. Dincolo de dezvoltarea gândirii critice și educația digitală – care sunt esențiale – nu există, în acest moment, un mecanism sigur care să ne garanteze protecția împotriva deepfake-urilor sofisticate, chiar dacă speranța este că oamenii care dezvoltă aceste unelte vor putea crea și antidotul – poate un fel de anticorpi algoritmici.

Asta înseamnă că nu avem o soluție clară pentru a preveni astfel de situații de tip deepfake?

Nu cred că există o soluție tehnică infailibilă pentru această problemă, dar cred că un prim pas ar fi să ne oferim mai mult timp pentru a procesa informațiile. Suntem atât de obișnuiți să consumăm fluxuri nesfârșite de conținut încât rareori ne oprim să facem corelații între ceea ce ni se prezintă și ceea ce știm deja despre un personaj public. În esență, ar trebui să ne antrenăm să facem interferențe plauzibile pe baza istoricului unei persoane. Dacă vedem un deepfake în care un politician face o declarație care contrazice în totalitate tot ce a spus și făcut până atunci, avem motive întemeiate să ne îndoim de autenticitatea acelui conținut. Să luăm un exemplu banal: dacă cineva este un fan înrăit al echipei Dinamo, are un tatuaj cu Dinamo, merge constant la meciuri și postează mereu despre echipă, iar peste ceva timp apare un deepfake cu el spunând „Forța Steaua“, probabilitatea ca acel conținut să fie fals este foarte mare. Dacă nu este fals, atunci există o mare șansă ca intenția comunicării să fie alta, poate o ironie sau o declarație scoasă din context. Așadar, în loc să ne bazăm exclusiv pe tehnologie pentru a ne proteja de deepfake-uri, trebuie să dezvoltăm o metodă mai bună de analiză a informației. Să privim orice conținut nou în raport cu întregul istoric al acelei persoane și să nu ne lăsăm influențați doar de impactul emoțional al unui videoclip sau al unei declarații izolate.